KI Ethik: Sichere Automatisierung steuern

Künstliche Intelligenz (KI) revolutioniert die Arbeitsweise von Unternehmen und verspricht Effizienz und Fortschritt im globalen Maßstab. Über 70 % der Führungskräfte glauben, dass KI künftig den wichtigsten Wettbewerbsvorteil darstellen wird.

Gleichzeitig bringt dieses Potenzial eine große Verantwortung mit sich: die Ethik der KI.

Ethik der KI (auch bekannt als Ethical AI oder Responsible AI) bezeichnet die Grundsätze und Maßnahmen, die sicherstellen, dass KI-Systeme moralisch vertretbar, fair und vertrauenswürdig arbeiten.

Da KI zunehmend in Entscheidungsprozesse und automatisierte Workflows eingebunden ist, müssen Entscheidungsträger die ethischen Aspekte verstehen und steuern, um eine sichere und nachhaltige Automatisierung zu erreichen.

Ethische Fehltritte bei KI können schwerwiegende Folgen für Unternehmen und Gesellschaft haben. Unkontrollierte KI-Systeme haben bereits zu voreingenommenen Ergebnissen geführt, die Privatsphäre verletzt oder undurchsichtige Entscheidungen mit großer Tragweite getroffen. Solche Vorfälle untergraben das Vertrauen und schaden dem Ruf.

Was ist Ethik der KI?

Source: Freepik

Die Ethik der Künstlichen Intelligenz (KI) umfasst ein breites Feld an Richtlinien, um sicherzustellen, dass KI-Technologien auf moralisch verantwortungsvolle Weise entwickelt und eingesetzt werden. IBM definiert Ethik der KI als „ein interdisziplinäres Feld, das untersucht, wie der positive Einfluss von Künstlicher Intelligenz maximiert und Risiken sowie unerwünschte Folgen reduziert werden können“.

Es geht dabei nicht nur um die Einhaltung von Vorschriften, sondern darum, KI mit menschlichen Werten und gesellschaftlichen Normen in Einklang zu bringen – und unser moralisches Verständnis auf den Einsatz neuer Technologien zu übertragen. In der Praxis bedeutet das: KI soll zum Guten beitragen (z. B. durch mehr Effizienz, bessere Entscheidungen oder verbesserte Kundenerlebnisse), ohne durch Fehlanwendung, Voreingenommenheit oder unbeabsichtigte Auswirkungen Schaden zu verursachen.

Eine Begriffsklärung: „Ethical AI“ beschreibt in der Regel Systeme, die ethisch korrekt gestaltet und genutzt werden, während „AI Ethics“ bzw. „Ethik der KI“ das gesamte Forschungs- und Regelungsfeld rund um die moralischen Fragen der KI meint. Kurz gesagt: Ethical AI ist das Ziel – die Ethik der KI liefert den Rahmen, um dieses Ziel zu erreichen.

Verständnis von KI-Ethik

Die Diskussion über Künstliche Intelligenz und Ethik umfasst zahlreiche Fragestellungen. Zu den wichtigsten Themen gehören die Vermeidung von Voreingenommenheit und Diskriminierung, die Sicherstellung von Transparenz und Nachvollziehbarkeit bei KI-Entscheidungen, der Schutz von Privatsphäre und Datenrechten, die Wahrung menschlicher Verantwortung für KI-Handlungen sowie die Verhinderung von Missbrauch – etwa bei böswilligen Anwendungen oder Verstößen gegen Menschenrechte.

Beispiele: Wie kann verhindert werden, dass ein KI-basiertes Bewerbungssystem Kandidat*innen aufgrund von Geschlecht oder Herkunft ungerecht ausschließt? Wie lässt sich sicherstellen, dass eine Diagnose-KI ihre Entscheidung nachvollziehbar erklärt? Wer trägt die Verantwortung, wenn ein autonomes Fahrzeug einen Unfall verursacht?

Zur Ethik der KI gehört auch Governance, also die Richtlinien, Werte und Kontrollmechanismen, die das Verhalten von KI-Systemen im Unternehmen steuern. Ethical AI erfordert, dass Unternehmen ihre Ethik- und Compliance-Programme auf den gesamten Lebenszyklus von KI-Systemen ausweiten, von der Konzeption und Datenauswahl über das Modelltraining bis hin zu Deployment und Monitoring. Nur so lassen sich die gleichen Standards für Integrität und Verantwortung durchsetzen, wie sie auch für menschliche Entscheidungen gelten.

Ein mangelhaftes ethisches KI-Governance kann den Ruf eines Unternehmens schädigen, rechtliche Konsequenzen nach sich ziehen und das Vertrauen von Stakeholdern untergraben. Umgekehrt zeigt die Forschung: Wer digitale Vertrauenswürdigkeit durch Datenschutz, Sicherheit und verantwortungsvollen KI-Einsatz stärkt, kann auch wirtschaftlich profitieren. Gleichzeitig profitiert die Gesellschaft insgesamt, wenn KI ethisch gestaltet wird, Grundrechte werden gewahrt, Diskriminierung vermieden, und das Vertrauen in KI-Technologien wächst.

In den letzten Jahren hat die Bedeutung von KI-Ethik stark zugenommen. Was früher vor allem Forschungsthema war, steht heute ganz oben auf der Agenda von Wirtschaft und Politik. Laut aktuellen Analysen ist „AI Ethics von der akademischen Forschung in die Praxis großer Tech-Unternehmen gewandert“, die nun eigene Teams für ethische Fragen aufbauen. Unternehmen wie IBM, Google und Meta haben Ethikgremien eingerichtet, die die Entwicklung ihrer Produkte begleiten. Parallel dazu arbeiten internationale Organisationen und nationale Behörden an konkreten Leitlinien – etwa die UNESCO mit ihrer globalen KI-Ethik-Initiative oder nationale Ethikräte in verschiedenen Ländern. Der Konsens wächst: KI darf nicht allein Entwicklerinnen überlassen werden, Ethikexpertinnen, politische Entscheidungsträger*innen und Unternehmensleitungen müssen gemeinsam sicherstellen, dass KI von Anfang an verantwortungsvoll gestaltet wird.

„AI Ethics von der akademischen Forschung in die Praxis großer Tech-Unternehmen gewandert“

Quelle: Coursera

Warum KI-Ethik für Unternehmen und Gesellschaft wichtig ist

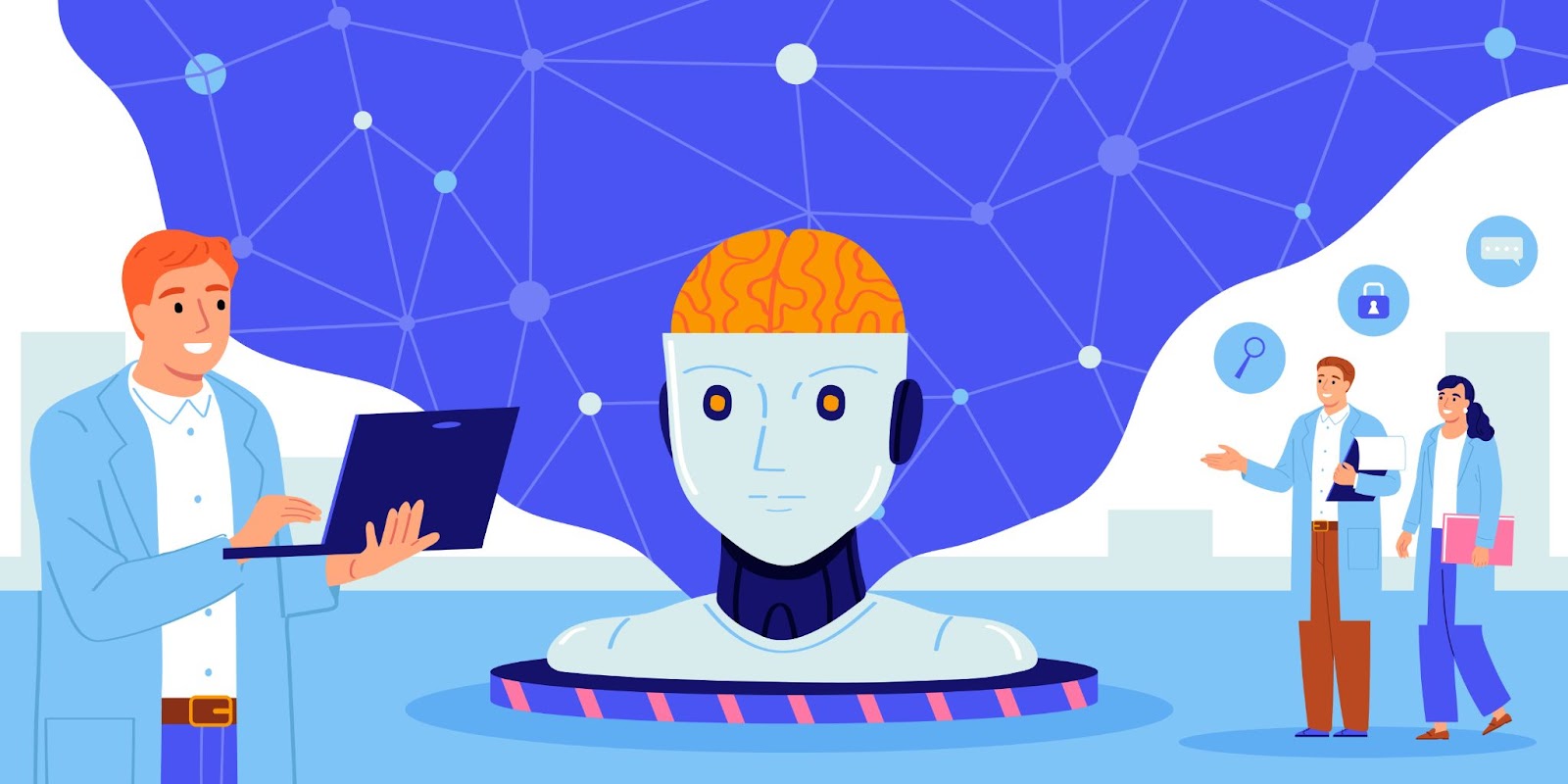

KI-Ethik ist kein reines PR-Thema oder altruistischer Luxus, sie hat konkrete Auswirkungen auf den Unternehmenserfolg und das gesellschaftliche Wohlergehen. Im Geschäftsbereich wird ethische KI zunehmend zu einem strategischen Muss. Eine weltweite Umfrage von McKinsey zeigt: Der Aufbau von digitalem Vertrauen (inklusive transparenter KI und Datennutzung) steht in direktem Zusammenhang mit Wachstum. Organisationen mit starken digitalen Vertrauenskapazitäten erreichen mit deutlich höherer Wahrscheinlichkeit ein jährliches Wachstum von über 10 %.

Quelle: erstellt von turian, basierend auf Daten von McKinsey.

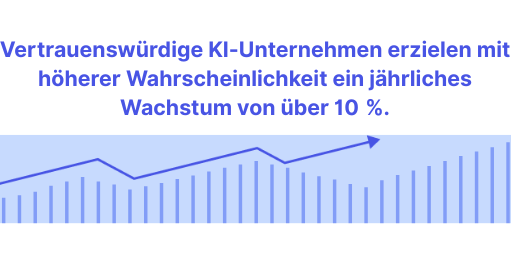

Verbraucherinnen treffen Kaufentscheidungen zunehmend auf Grundlage der ethischen Haltung eines Unternehmens. Besonders Transparenz ist entscheidend:

- Die meisten Verbraucher sagen, dass es wichtig ist, dass Unternehmen ihre KI- und Datenrichtlinien klar kommunizieren, und fast die Hälfte würde einen Markenwechsel in Betracht ziehen, wenn ein Unternehmen nicht klar darlegt, wie es Kundendaten verwendet.

- Über die Hälfte der Verbraucher kauft oft nur bei Unternehmen, die dafür bekannt sind, Daten zu schützen und ethisch zu verwenden.

- Viele Verbraucher glauben, dass eine ethische und vertrauenswürdige Reputation genauso wichtig ist wie übliche Kaufentscheidungsfaktoren wie die Lieferzeit.

Quelle: erstellt von turian, basierend auf Daten von McKinsey.

Diese Entwicklungen zeigen: Unternehmen haben ein wirtschaftliches Interesse, KI-Ethik ernst zu nehmen, sie stärkt Kundenbindung, reduziert Risiken und kann sogar zum Marktvorteil werden.

Umgekehrt kann das Vernachlässigen ethischer Aspekte zu Vertrauensverlust, rechtlichen Sanktionen und öffentlichem Gegenwind führen. Fehlende ethische Kontrolle wird schnell zum Haftungsrisiko, etwa bei Datenschutzverstößen oder diskriminierenden Ergebnissen. Expert*innen bei IBM warnen, dass Ignorieren von KI-Ethik zu „Reputations-, Regulierungs- und Rechtsrisiken“ führen kann.

Auch aus gesellschaftlicher Sicht ist KI-Ethik entscheidend, damit KI allen nützt und Ungleichheiten nicht verschärft. Unkontrollierte Systeme können historische Vorurteile verstärken oder unbeabsichtigt benachteiligte Gruppen schädigen. Die UNESCO warnt, dass der rasante KI-Fortschritt „tiefe ethische Fragen“ aufwirft, da KI „Vorurteile verfestigen und bereits marginalisierte Gruppen weiter benachteiligen kann“.

Ein Beispiel: Ein Unternehmen nutzt eine KI zur Bewerberauswahl, die auf historischen Einstellungsdaten basiert. Diese spiegeln bestehende Muster und Vorurteile wider – etwa eine Unterrepräsentation von Frauen oder ethnischen Minderheiten. Die KI stuft dann solche Bewerbungen systematisch ab – nicht aus bösem Willen, sondern weil das Trainingsmaterial die Realität verzerrt. Genau deshalb braucht die Gesellschaft ethische Leitplanken für KI.

Gabriela Ramos, Beigeordnete Generaldirektorin der UNESCO, bringt es auf den Punkt: „Ohne ethische Leitplanken droht KI, reale Vorurteile und Diskriminierung zu reproduzieren, Spaltungen zu fördern und grundlegende Menschenrechte und Freiheiten zu gefährden.“

Staaten und Regulierungsbehörden weltweit reagieren auf diese Risiken und entwickeln Richtlinien für ethischen KI-Einsatz. Der Trend ist eindeutig: Unternehmen werden bald rechtlich verpflichtet sein, viele Prinzipien der KI-Ethik umzusetzen. Wer sich frühzeitig darum kümmert, macht sich zukunftssicher – und gewinnt zugleich Vertrauen der Öffentlichkeit.

Kurz gesagt: KI-Ethik stärkt Vertrauen und schützt vor Risiken, die KI-Projekte scheitern lassen könnten. Ethische KI fördert gesellschaftliche Akzeptanz und ermöglicht Unternehmen, die Vorteile von KI voll auszuschöpfen – ohne die negativen Seiten der Technologie in Kauf nehmen zu müssen.

Ein Zeichen für die wachsende Bedeutung: 2021 stuften 75 % der Führungskräfte weltweit KI-Ethik als „wichtig“ ein – ein deutlicher Anstieg gegenüber unter 50 % im Jahr 2018. Was einst Nischenthema war, ist heute zur geschäftlichen Grundvoraussetzung geworden.

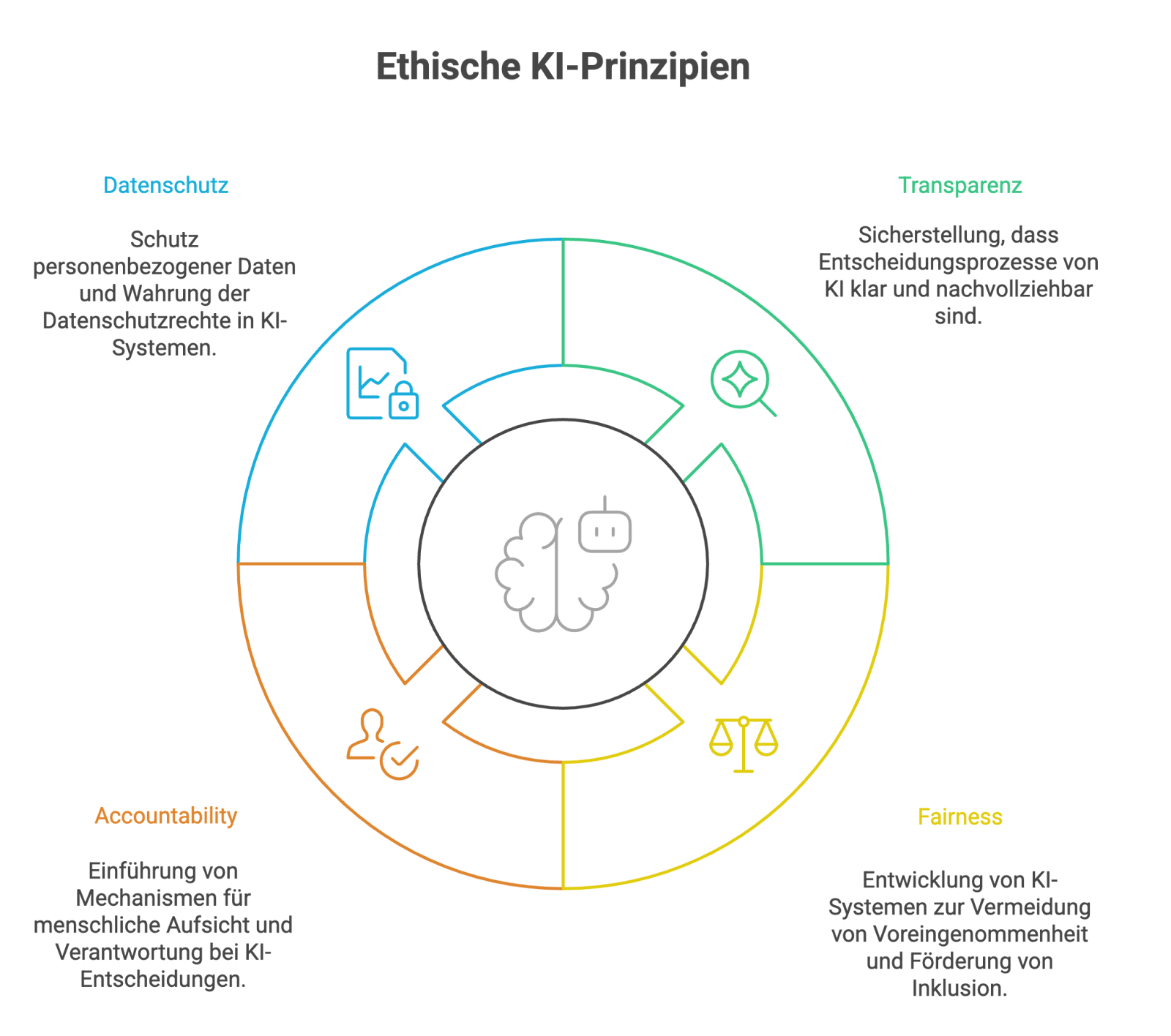

Zentrale ethische Prinzipien für die Umsetzung von KI

Die Umsetzung von ethischer KI in der Praxis beginnt mit einer Reihe zentraler Prinzipien. Diese Grundsätze dienen Unternehmen als Kompass, um KI-Systeme verantwortungsvoll zu entwickeln, einzusetzen und zu steuern. Zwar existiert kein weltweit einheitlicher Katalog für ethische KI-Prinzipien, doch zu den am häufigsten genannten zählen:

Quelle: turian

Transparenz

Die Entscheidungs- oder Vorhersageprozesse eines KI-Systems sollten so klar wie möglich nachvollziehbar sein – entweder direkt oder über Tools, die das Vorgehen der KI erklären. Dazu gehört die Erklärbarkeit, also die Möglichkeit, den Weg von Eingabedaten zu Ergebnissen nachzuvollziehen, und die Kennzeichnung, sodass Menschen erkennen können, ob sie mit einer KI, einer Person oder klassischer Software interagieren. Auch Regulierungsbehörden betonen Transparenz: Der Entwurf des EU AI Act enthält entsprechende Vorgaben für bestimmte KI-Systeme, und auch die globale KI-Empfehlung der UNESCO nennt „Transparenz und Erklärbarkeit“ als Grundvoraussetzung zum Schutz der Menschenrechte.

Fairness

Ergebnisse von KI-Systemen sollen gerecht, unparteiisch und inklusiv sein. KI darf keine systematischen Benachteiligungen gegenüber bestimmten Gruppen erzeugen – etwa aufgrund von Merkmalen wie Geschlecht, ethnischer Herkunft, Alter oder anderen geschützten Eigenschaften. Fairness umfasst auch Zugänglichkeit: Der Nutzen von KI sollte für verschiedene Bevölkerungsgruppen zugänglich sein.

Verantwortlichkeit

Es muss klare Mechanismen geben, die sicherstellen, dass Menschen die Verantwortung für das Verhalten und die Ergebnisse von KI-Systemen übernehmen. Auch wenn eine Entscheidung automatisiert getroffen wird, sollte eine Organisation letztlich für diese Entscheidung rechenschaftspflichtig sein.

Datenschutz und Privatsphäre

Dieses Prinzip zielt darauf ab, persönliche Daten zu schützen und sicherzustellen, dass KI-Systeme die Rechte auf Privatsphäre wahren. Da KI oft auf großen Datenmengen basiert – darunter auch sensible Informationen – verlangt dieses Prinzip, dass Daten nur mit Einwilligung, sicher und nicht zum Nachteil der Betroffenen genutzt werden. Dazu gehört auch Transparenz über die Datennutzung sowie die Einholung einer informierten Zustimmung, wo erforderlich. Ein weiterer Aspekt ist die Absicherung gegen Datenlecks: KI-Systeme müssen über robuste Sicherheitsvorkehrungen verfügen, da ein einziger Vorfall viele Menschen gleichzeitig betreffen kann. Datenschutz ist auch rechtlich verankert, etwa durch die Datenschutz-Grundverordnung (DSGVO) der EU, eines der strengsten Datenschutzgesetze weltweit.

{{cta="/de/cta/automate-quality-management-with-ai-agents"}}

Ethische KI in der Praxis umsetzen: Ein Leitfaden

Mit der zunehmenden Integration von KI in Geschäftsprozesse wird die Umsetzung ethischer KI-Praktiken unerlässlich, um sicherzustellen, dass KI-Systeme im Einklang mit menschlichen Werten und gesellschaftlichen Normen entwickelt und eingesetzt werden. Führende Unternehmen haben umfassende Rahmenwerke geschaffen, um die ethische Entwicklung und den verantwortungsvollen Einsatz von KI zu steuern.

Einige wichtige Schritte:

1. Ethische Leitlinien festlegen

Entwickeln Sie ethische Grundsätze, die mit den Werten Ihres Unternehmens übereinstimmen und geltende gesetzliche Vorgaben berücksichtigen. Die zuvor besprochenen Prinzipien sollten den gesamten Lebenszyklus von KI-Systemen begleiten. Indem diese Grundsätze in interne Richtlinien und Prozesse integriert werden, schaffen Unternehmen ein stabiles Fundament für die verantwortungsvolle Nutzung von KI.

2. Robuste Governance-Strukturen einführen

Schaffen Sie klare Rahmenbedingungen zur Steuerung von KI-Initiativen. Definieren Sie Zuständigkeiten und Rollen, um sicherzustellen, dass ethische Überlegungen in allen Phasen der KI-Entwicklung berücksichtigt werden. Führen Sie regelmäßige Audits, Risikoanalysen und Überprüfungen durch, um mögliche Verzerrungen zu erkennen und die Einhaltung ethischer Standards sicherzustellen. Halten Sie Ihre Governance-Strukturen aktuell – auch im Hinblick auf neue Gesetze und Vorschriften.

3. Transparenz und Nachvollziehbarkeit sicherstellen

Nutzen Sie Tools und Methoden, um Entscheidungen von KI-Systemen für Beteiligte nachvollziehbar zu machen. Erstellen Sie eine klare Dokumentation über die Entwicklung, Datenquellen und Entscheidungsprozesse Ihrer KI-Systeme. Wenden Sie Methoden zur Erklärbarkeit an, damit Nutzer die Ergebnisse besser verstehen können – das stärkt Vertrauen und Verantwortlichkeit.

4. Fairness sicherstellen und Verzerrungen minimieren

Überprüfen Sie KI-Modelle regelmäßig auf Verzerrungen. Wenden Sie Strategien wie Pre-Processing, In-Processing und Post-Processing an, um Vorurteile im Modell zu reduzieren. Achten Sie auf vielfältige und repräsentative Trainingsdaten, um sicherzustellen, dass algorithmische Entscheidungen keine bestimmten Gruppen benachteiligen.

5. Menschliche Kontrolle gewährleisten

Stellen Sie sicher, dass Ihre KI-Systeme Human-in-the-Loop-Mechanismen beinhalten. Legen Sie klar fest, wer in Ihrem Unternehmen für die Überprüfung und Freigabe von KI-Ergebnissen zuständig ist. Führen Sie insbesondere bei sensiblen Anwendungsfällen menschliche Überprüfungen durch – dort, wo fehlerhafte Ergebnisse schwerwiegende Folgen haben könnten.

6. Fortlaufende Schulungen und Sensibilisierung fördern

Bieten Sie fundierte Schulungen für Ihre Teams an. Mitarbeitende sollten über das nötige Wissen verfügen, um ethische Herausforderungen rund um KI zu erkennen und zu bewerten. Entwickeln Sie ein Schulungskonzept, das sowohl Grundlagen als auch rollenbezogene Inhalte abdeckt. Fördern Sie kontinuierliches Lernen und halten Sie die Inhalte aktuell.

Regulatorischer Rahmen für KI-Ethik

Weltweit arbeiten Regierungen und Aufsichtsbehörden mit Hochdruck an der Entwicklung von Richtlinien und Gesetzen zur Regulierung der KI-Ethik. Dieses regulatorische Umfeld entwickelt sich rasant, mit neuen Vorschlägen und Rahmenwerken auf internationaler, nationaler und branchenspezifischer Ebene. Führungskräfte sollten diese Entwicklungen genau verfolgen, da sie zukünftige Compliance-Anforderungen und bewährte Praktiken für den KI-Einsatz mitbestimmen werden. Im Folgenden finden Sie einen Überblick über einige der wichtigsten regulatorischen und politischen Initiativen im Bereich der KI-Ethik.

KI-Gesetz der Europäischen Union

Eine der bisher bedeutendsten Regulierungsinitiativen ist das KI-Gesetz der Europäischen Union, voraussichtlich der erste umfassende Rechtsrahmen für künstliche Intelligenz. Die Verordnung (EU) 2024/1689 verfolgt einen risikobasierten Ansatz zur Regulierung von KI-Systemen. Sie kategorisiert KI nach Risikostufen: Unvertretbares Risiko, Hohes Risiko, Begrenztes Risiko und Minimales Risiko.

Ziel des KI-Gesetzes ist die Förderung von vertrauenswürdiger KI, die „Sicherheit, Grundrechte und menschenzentrierte KI“ garantiert und gleichzeitig Innovation ermöglicht.

Die Überwachung liegt bei zuständigen Behörden. Anbieter müssen Systeme zur Überwachung nach der Markteinführung bereitstellen. Betreiber sind zur menschlichen Kontrolle und Beobachtung verpflichtet. Die Umsetzung und Durchsetzung erfolgt durch das Europäische KI-Büro sowie die zuständigen Behörden der EU-Mitgliedstaaten.

Ziel des KI-Gesetzes ist die Förderung von vertrauenswürdiger KI, die „Sicherheit, Grundrechte und menschenzentrierte KI“ garantiert und gleichzeitig Innovation ermöglicht.

Quelle: European Commission

Datenschutz-Grundverordnung (DSGVO) und Datenschutzgesetze

Schon vor speziellen KI-Gesetzen haben Datenschutzverordnungen indirekt ethische Standards für KI durchgesetzt. Die DSGVO (seit 2018 in Kraft) ist dabei das bekannteste Beispiel.

Sie regelt alle KI-Anwendungen, die personenbezogene Daten von EU-Bürgern verarbeiten. Besonders relevant ist Artikel 22, der Einzelpersonen das Recht gibt, nicht ausschließlich automatisierten Entscheidungen unterworfen zu sein, die „rechtliche oder ähnlich erhebliche Auswirkungen“ haben. Außerdem können Betroffene eine menschliche Prüfung oder eine verständliche Erklärung verlangen. Diese Vorgabe wirkt automatisierten Prozessen im Kreditwesen, Recruiting oder Versicherungsbereich entgegen.

{{cta="/de/cta/validate-certificates-instantly-with-ai-agents"}}

UNESCO-Empfehlung zur KI-Ethik

Auf globaler Ebene stellte die UNESCO im November 2021 einen Meilenstein auf: Alle 193 Mitgliedsstaaten verabschiedeten einstimmig die Empfehlung zur Ethik der Künstlichen Intelligenz, das weltweit erste völkerrechtlich relevante Standardwerk zur KI-Ethik.

Die Empfehlung ist zwar nicht rechtlich bindend, stellt aber einen breiten internationalen Konsens zu ethischen Grundsätzen dar. Sie umfasst zehn zentrale Prinzipien, darunter viele der bereits genannten: Transparenz, Erklärbarkeit, Fairness, Nichtdiskriminierung, Verantwortlichkeit, Datenschutz, menschliche Aufsicht und mehr.

Zahlreiche Unternehmen orientieren sich bereits an den UNESCO-Prinzipien. So hat etwa SAP seine KI-Ethikrichtlinien entsprechend überarbeitet.

Weitere relevante Rahmenwerke und Initiativen

OECD-Leitprinzipien für KI

Die OECD (Organisation für wirtschaftliche Zusammenarbeit und Entwicklung) verabschiedete 2019 fünf KI-Grundsätze, die mittlerweile von zahlreichen Ländern unterstützt werden. Diese Prinzipien betonen integratives Wachstum, menschenzentrierte Werte, Transparenz, Robustheit (Sicherheit) und Verantwortlichkeit, sowie die Bedeutung internationaler Zusammenarbeit bei der Regulierung von KI. Die OECD-Leitlinien haben die EU und andere Ansätze beeinflusst und führten zur Gründung der Global Partnership on AI (GPAI) – eines internationalen Gremiums für die Zusammenarbeit im Bereich KI-Ethik und -Politik.

EU-Leitlinien für vertrauenswürdige KI

Bereits vor dem KI-Gesetz veröffentlichte eine hochrangige EU-Expertengruppe im Jahr 2019 Leitlinien für vertrauenswürdige KI, die sieben Anforderungen beschreiben: menschliche Selbstbestimmung und Aufsicht, technische Robustheit und Sicherheit, Datenschutz und Daten-Governance, Transparenz, Vielfalt, Nichtdiskriminierung und Fairness, gesellschaftliches und ökologisches Wohlergehen sowie Verantwortlichkeit. Diese Leitlinien sind in der Industrie weit verbreitet und flossen in das Risikorahmenwerk des KI-Gesetzes ein.

Selbstregulierung und Branchenstandards

Auch Branchenverbände und Normungsorganisationen tragen zur Entwicklung bei. Das Institute of Electrical and Electronics Engineers (IEEE) arbeitet beispielsweise an der Initiative Ethically Aligned Design sowie an Standards wie IEEE 7001-2021 für Transparenz. Die Internationale Organisation für Normung (ISO) entwickelt KI-spezifische Standards (ISO/IEC JTC 1/SC 42), unter anderem zum Risikomanagement. Unternehmen wie Google, Microsoft, IBM und andere haben eigene Ethikleitlinien veröffentlicht und Toolkits für verantwortungsvolle KI open-source bereitgestellt (z. B. Googles What-If-Tool zur Verzerrungstests, IBMs AI Fairness 360). Diese Instrumente gelten zwar nicht als rechtlich bindend, schaffen jedoch Erwartungen zur Selbstregulierung innerhalb der Technologiebranche.

Nationale Strategien und Gesetze

Neben der EU gehen auch andere Regierungen eigene Wege:

- Großbritannien verfolgt einen flexibleren Ansatz mit einem KI-Rahmen, der die Verantwortung bestehenden Aufsichtsbehörden überträgt und keine einheitliche Verordnung vorsieht.

- In den USA gibt es auf Bundesebene noch keine umfassende KI-Gesetzgebung, aber das Weiße Haus hat ein „Blueprint for an AI Bill of Rights“ veröffentlicht, ein Leitfaden mit Grundsätzen wie sichere und effektive Systeme, Schutz vor algorithmischer Diskriminierung, Datenschutz, Erklärbarkeit und menschliche Alternativen.

- China hat ethische Leitlinien für KI erlassen und Vorschriften für bestimmte Anwendungen eingeführt (z. B. Empfehlungsalgorithmen, Deepfakes), die Transparenz verlangen und bestimmte Verhaltensweisen untersagen, mit starkem Fokus auf soziale Stabilität.

- Weitere Länder wie Kanada, Australien, Singapur und Brasilien haben bereits Rahmenwerke für verantwortungsvolle KI entwickelt oder angekündigt.

Sektor-spezifische Vorschriften

Einige Branchen verfügen über eigene Ethikrichtlinien:

- Gesundheitswesen: Die Weltgesundheitsorganisation (WHO) veröffentlichte 2021 Leitlinien zur Ethik und Governance von KI im Gesundheitswesen, mit Fokus auf Patientensicherheit, Verantwortlichkeit und Inklusion.

- Finanzwesen: Die Branche unterliegt strengen Vorschriften zu Fairness und Transparenz. KI-Anwendungen wie Kreditbewertung oder algorithmischer Handel stehen im Fokus der Aufsichtsbehörden. Viele solcher Systeme werden im Rahmen des EU-KI-Gesetzes als Hochrisiko-KI eingestuft.

- Verteidigung: Auch im militärischen Bereich gibt es Diskussionen zur KI-Ethik. Die NATO und das US-Verteidigungsministerium haben Prinzipien für den ethischen KI-Einsatz im Krieg verabschiedet – mit Schwerpunkt auf Verantwortlichkeit, Rückverfolgbarkeit, Zuverlässigkeit und menschlicher Kontrolle, insbesondere bei Entscheidungen mit tödlichen Folgen.

Die globale Entwicklung geht eindeutig in Richtung mehr Aufsicht über KI, um ethische Standards sicherzustellen. Für Unternehmen bedeutet das: KI-Ethik ist kein „Nice-to-have“, sondern bald ein Compliance-Muss. Wer früh handelt, ist regulatorisch besser vorbereitet und kann gleichzeitig Vertrauen bei Kundinnen und Kunden aufbauen.

Wichtige Erkenntnisse für Führungskräfte

- Binden Sie frühzeitig Rechtsabteilungen oder Compliance-Beauftragte in Ihre KI-Initiativen ein, um regulatorische Anforderungen sicher zu erfüllen. Multinationale Unternehmen sollten sich an den strengsten geltenden Standards orientieren – diese setzen sich häufig als globale Basis durch.

- Behalten Sie regulatorische Entwicklungen in allen Ländern im Blick, in denen Sie tätig sind oder Nutzende haben. Die Anforderungen können stark variieren: In Illinois (USA) ist z. B. eine Zustimmungspflicht bei KI-gestützter Personalauswahl gesetzlich vorgeschrieben, in New York City gibt es ein Gesetz zu Bias-Audits bei KI-Einstellungssoftware.

- Nehmen Sie, wenn möglich, an Branchengremien oder öffentlichen Konsultationen teil. Viele Regulierungsbehörden holen gezielt Rückmeldungen aus der Industrie ein – durch aktive Beteiligung erhalten Sie Einblick in neue Vorgaben und können zu ausgewogenen Regelungen beitragen.

- Behandeln Sie ethische Prinzipien wie Compliance-Vorgaben: Dokumentieren Sie Fairness- und Risikoprüfungen, führen Sie Transparenzprotokolle (z. B. zur Trainingsmethode oder verwendeten Daten), und richten Sie Aufsichtsgremien ein. Diese Maßnahmen erfüllen nicht nur ethische Anforderungen, sondern schaffen auch Nachweise für die Einhaltung gesetzlicher Vorgaben.

Wie turian Sie bei ethisch verantwortungsvollen KI-Workflows unterstützt

turian ist überzeugt: Ethische KI ist entscheidend, um echten Mehrwert zu schaffen und Vertrauen bei Kundinnen und Kunden zu sichern. Die Plattform von turian ist von Grund auf so konzipiert, dass ethische Prinzipien eingehalten werden – für sichere, transparente und faire Automatisierung. So unterstützt turian Sie dabei, KI-gestützte Workflows verantwortungsvoll zu steuern:

- Unsere Plattform enthält Human-in-the-Loop-Mechanismen, um bei wichtigen Automatisierungen menschliche Kontrolle sicherzustellen. Diese Kombination aus KI-Geschwindigkeit und menschlichem Urteilsvermögen gewährleistet verlässliche und nachvollziehbare Abläufe.

- turian sorgt für transparente und prüfbare KI-Abläufe – nichts bleibt für Nutzende im Verborgenen.

- Wir folgen strengen Datenstandards und führen Tests durch, um Bias und Unfairness in KI-Ergebnissen frühzeitig zu erkennen und zu minimieren.

- Viele Anwendungsfälle bei turian betreffen geschäftsrelevante Daten, darunter auch personenbezogene Informationen zu Mitarbeitenden, Kundschaft oder Lieferanten (z. B. E-Mails, Bestellungen, Compliance-Dokumente). Unsere Plattform ist mit starken Datenschutzmaßnahmen ausgestattet: Zugriffsrechte sind klar geregelt, Daten werden verschlüsselt, wir erfüllen Vorgaben wie die DSGVO, unterstützen Einwilligungsmanagement und respektieren individuelle Nutzerrechte.

- Unsere Tools bieten umfassende Governance-Funktionen, etwa Admin-Kontrollen und Prüf-Workflows, mit denen Unternehmen eigene Regeln für den KI-Einsatz festlegen können.

- Unsere Lösungen werden kontinuierlich weiterentwickelt, um aktuelle ethische Standards zu erfüllen und neue regulatorische Anforderungen abzudecken.

Fazit

Während wir das Potenzial von KI nutzen, müssen wir ebenso die Verantwortung übernehmen, sie mit einem ethischen Kompass zu steuern. Ethik für KI ist keine Randnotiz – sie ist eine aktive Governance-Aufgabe, der sich Unternehmen stellen müssen.

Der Auftrag ist klar: Ethische KI muss als geschäftskritisch verstanden und behandelt werden. Stellen Sie die wichtigen Fragen zu KI-Projekten:

„Könnte dieser Entscheidungsprozess unfair sein? Wie erklären wir ihn? Entspricht er unseren Werten und Gesetzen? Wer übernimmt die Verantwortung, wenn etwas schiefläuft?“ – und verlangen Sie tragfähige Antworten, bevor Sie weitermachen. Fördern Sie eine Unternehmenskultur, in der Ethik alle etwas angeht. Und wählen Sie Partner und Plattformen – wie turian –, die ethische Prinzipien von Beginn an in ihre Technologie integrieren.

KI bleibt – und ihre Bedeutung wächst. Mit klarer Steuerung und Integrität lässt sich ihr enormes Potenzial für Produktivität und Innovation nutzen, ohne dabei Sicherheit, Fairness oder den Menschen aus dem Blick zu verlieren. Ethische KI bedeutet nicht nur, das Richtige zu tun – sondern das Klügste für nachhaltigen Erfolg. Wenn wir Workflows automatisieren und KI-Agents einsetzen, dann mit einem bewussten Blick auf ethische Fragen, damit Automatisierung sicher, vertrauenswürdig und für alle von Vorteil ist. Mit den richtigen Rahmenbedingungen und Partnern wird KI zu einer positiven Kraft für Ihr Unternehmen – und steht für die Werte, die Sie vertreten.